Признавая распространенность дезинформации и ее потенциал причинения вреда, многие платформы социальных сетей приняли меры по ограничению, удалению или борьбе как с дезинформацией, так и с некорректной информацией, различными способами. Эти реакции обычно основываются на политиках платформ в отношении контента и поведения и в основном реализуются с помощью функций продукта и технического или человеческого вмешательства. В этом разделе рассматриваются различные подходы, которые компании использовали для борьбы с цифровой дезинформацией на своих платформах.

Иногда модерация контента в социальных сетях осуществляется под предлогом борьбы с дезинформацией, хотя на самом деле она служит нелиберальным целям правительства. Важно отметить, что платформы, контролируемые компаниями в авторитарных странах, часто удаляют дезинформацию и другой вредоносный контент. Это может вызвать серьезные проблемы цензуры, особенно когда вред определяется как критика в адрес правительства, при котором работает компания.

(A). Политика платформы в отношении дезинформации и некорректной информации

Несколько крупнейших и самых популярных социальных сетей в мире разработали политику по борьбе с дезинформацией и некорректной информацией. В этом разделе рассматриваются некоторые из наиболее важных политик частного сектора в ответ на дезинформацию, в том числе со стороны Facebook, Twitter и YouTube, а также таких растущих компаний, как Tik Tok и другие.

1. Политики Facebook

В Facebook действия пользователей регулируются набором политик, известных как стандарты сообщества.. Этот свод правил в настоящее время не запрещает дезинформацию или некорректную информацию в целом; однако в нем есть несколько запретов, которые могут применяться к противодействию дезинформации и некорректной информации в определенных контекстах. Например, стандарты сообщества запрещают контент, который искажает информацию о голосовании или выборах, подстрекает к насилию, пропагандирует разжигание ненависти или включает дезинформацию, связанную с пандемией Covid-19. Кроме того, стандарты сообщества запрещают «Скоординированное манипулятивное воздействие», которое определяется как общий запрет на действия, характерные для крупномасштабных информационных операций на платформе. Сети, участвующие в скоординированном манипулятивном воздействии, после обнаружения удаляются. Кроме того, Facebook начал разрабатывать политику в сотрудничестве с экспертами, разрабатывая технологии для повышения безопасности женщин на своей платформе и в своем семействе приложений. Правила, направленные против преследований, нежелательных сообщений и интимных изображений без согласия, которые непропорционально нацелены на женщин, являются частью усилий Facebook во имя того, чтобы женщины чувствовали себя в большей безопасности.

За пределами этих конкретных контекстов Стандарты сообщества Facebook включают признание того, что, хотя дезинформация по сути не запрещена, компания несет ответственность за сокращение распространения «фейковых новостей». Принимая на себя эту ответственность, Facebook обязуется алгоритмически сокращать (или понижать в рейтинге) распространение такого контента в дополнение к другим шагам по смягчению его воздействия и сдерживанию его распространения. Компания также разработала политику удаления определенных категорий манипулятивных медиа, которые могут вводить пользователей в заблуждение; однако сфера действия этой политики ограничена. Данная политика распространяется только на медиа, являющиеся продуктом искусственного интеллекта или машинного обучения, и включает допущение для любых медиа, которые считаются сатирой, или контентом, который редактирует, пропускает или изменяет порядок фактически сказанных слов.

Стоит признать, что, хотя политики Facebook обычно применяются ко всем пользователям, компания отмечает, что «[в] некоторых случаях мы разрешаем контент, который в противном случае противоречил бы нашим стандартам сообщества — если он заслуживает освещения в СМИ и отвечает общественным интересам». Компания также указала, что выступление политиков обычно рассматриваются как подпадающие под действие исключения, касающегося информационной ценности, и, следовательно, не подлежат удалению. Однако такие сообщения подлежат маркировке, которая означает, что сообщения нарушают стандарты сообщества. В последние годы Facebook предпринял шаги по удалению политических выступлений и лишению слова политиков, в том числе бывшего президента Дональда Трампа, после нападения 6 января на Капитолий в США. В 2018 году Facebook также отключил от платформы Мин Аунг Хлаинга и высшее военное руководство Мьянмы за проведение кампаний по дезинформации и подстрекательство к этническому насилию.

2. Политика Twitter

Правила Twitter регулируют допустимое содержание в Twitter, и пока нет общей политики по дезинформации, Правила включают в себя несколько положений для обработки ложного или недопустимого контента и поведения в определенных контекстах. Политика Twitter запрещает дезинформацию и другой контент, который может подавлять участие или вводить людей в заблуждение относительно того, когда, где и как участвовать в гражданском процессе ; контент, содержащий разжигание ненависти или подстрекающий к насилию или домогательствам; или контент, который прямо противоречит рекомендациям авторитетных источников глобальной и местной информации в области общественного здравоохранения. Twitter также запрещает манипулятивное воздействие и спам, который является элементом информационных операций, использующим дезинформацию и другие формы манипулятивного содержания. Что касается дезинформации, Twitter обновил свою политику в отношении разжигающего ненависть поведения, чтобы запретить язык, унижающий человеческое достоинство по признаку расы, этнической принадлежности и национального происхождения.

После консультаций с общественностью Twitter также принял политику в отношении распространения синтетических или манипулятивных медиа, которые могут вводить пользователей в заблуждение. Политика требует оценки трех элементов, в том числе: (1) манипулируют ли самими СМИ (или информация специально подготовлена); (2) медиа-ресурсы распространяются обманным или вводящим в заблуждение образом; а также (3) контент рискует причинить серьезный вред (включая физическую безопасность пользователей, риск массового насилия или гражданских беспорядков, а также любые угрозы конфиденциальности или способности человека или группы свободно выражать свое мнение или участвовать в гражданских мероприятиях). Если все три элемента политики соблюдены, включая определение того, что контент может причинить серьезный вред, Twitter удалит контент. Если соблюдены только некоторые элементы, Twitter может пометить контент как манипулятивный, предупреждает пользователей, которые пытаются поделиться им, или прикрепляет ссылки на достоверный контент для проверки фактов, чтобы предоставить дополнительный контекст.

В контексте электоральной и политической дезинформации политика Twitter в отношении выборов заключается в том, чтобы прямо запретить вводящую в заблуждение информацию о процессе голосования. В его правилах указано: «Вы не можете использовать сервисы Twitter с целью манипулирования или вмешательства в выборы или другие гражданские процессы. Это включает размещение или совместное использование контента, который может подавлять участие или вводить людей в заблуждение относительно того, когда, где и как участвовать в гражданском процессе». Однако неточные утверждения об избранном или назначенном должностном лице, кандидате или политической партии исключаются из этой политики. В соответствии с этими правилами, Twitter удаляет сообщения, содержащие дезинформацию о процессе выборов, например, рекламирующие неправильный день голосования или ложную информацию о местах для голосования — это относится к контенту, который наблюдатели за выборами ОПВ и другие организации все чаще отслеживают и сообщают о нем. Примечательно, что твиты избранных должностных лиц и политиков могут пересекаться с общественными интересами Твиттера.

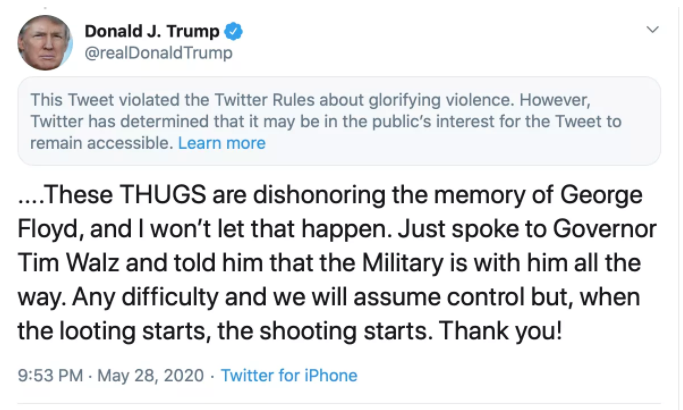

За исключением их общественных интересов, Twitter отмечает, что он «может оставить твит избранного или государственного должностного лица, который в противном случае был бы удален», и ссылается на заинтересованность общественности в получении информации о действиях и заявлениях официальных лиц. Когда применяется это исключение, вместо того, чтобы удалять оскорбительный контент, Twitter «поместит его за уведомлением, содержащим контекст о нарушение правил который позволяет людям переходить по ссылке, чтобы увидеть твит». Компания установила критерии для определения того, когда твит, нарушающий ее политику, может подпадать под это исключение общественных интересов, которое включает:

- Твит нарушил одно или несколько правил платформы

- Размещен с проверенной учетной записи

- У аккаунта более 100 000 подписчиков

- Учетная запись представляет действующего или потенциального члена государственного или законодательного органа.

При рассмотрении того, как применить это исключение, компания также разработала и опубликовала набор протоколов. для сопоставления потенциального риска и серьезности вреда со значением твита, представляющим общественный интерес. Во время президентских выборов 2020 г. в США Twitter применил перекрестное уведомление об общественном интересе ко многим твитам бывшего президента Дональда Трампа. Для твитов, подпадающих под этот ярлык, отображается следующее предупреждение, как показано ниже:

После нападения 6 января на Капитолий в США и твитов, содержащих подстрекательства к насилию, Twitter заблокировал бывшего президента Трампа на своей платформе. Компания опубликовала блог с обоснованием этой меры.

Наконец, стоит также отметить, что Twitter продемонстрировал готовность разрабатывать политики в ответ на конкретные темы, которые представляют риск загрязнения информационной среды платформы. Например, компания внедрила специальный набор политик за удаление контента, связанного с теорией заговора QAnon и аккаунтов, которые ее пропагандируют. С начала пандемии COVID-19 Twitter также разработал политику противодействия дезинформации и некорректной информации, связанной с COVID, в том числе политику в связи с вводящей в заблуждение информации о COVID-19, влияющей на здоровье и общественную безопасность.

3. Политика YouTube

YouTube следует политике трех предупреждений, которая приводит к приостановке или закрытию учетных записей-нарушителей, связанных с дезинформацией. Политика YouTube включает несколько положений, касающихся дезинформации в определенных контекстах, в том числе для контента, направленного на введение избирателей в заблуждение относительно времени, места, средств или требований к участию в голосовании или участии в переписи ; выдвижения ложных утверждений, связанных с квалификационными требованиями для политических кандидатов для того, чтобы баллотироваться на должность, и выборных государственных должностных лиц для работы в должности; или пропаганды насилия или ненависти по отношению к отдельным лицам или группам, или преследования их на основании присущих им атрибутов. Кроме того, YouTube также расширил свою политику борьбы с преследованиями, которая запрещает создателям видео использовать язык вражды и оскорбления по признаку пола, сексуальной ориентации или расы.

Как и на других платформах, правила также включают особую политику против дезинформации, касающейся общественного здравоохранения или медицинской информации в контексте пандемии COVID-19. Поскольку вводящие в заблуждение видеоролики на YouTubeо коронавирусе набрали 62 миллиона просмотров всего за первые несколько месяцев пандемии, YouTube сообщил об удалении « тысяч и тысяч» видео, распространяющих дезинформацию в нарушение политики платформы. Платформа подтвердила свое обязательство остановить распространение такого вредоносного контента.

YouTube также разработал политику в отношении манипулируемых СМИ, которая запрещает контент, технически измененный или подделанный таким образом, что вводит пользователей в заблуждение (за исключением клипов, вырванных из контекста) и может представлять значительный риск серьезного ущерба. Чтобы еще больше снизить риски манипуляций или кампаний по дезинформации, YouTube также проводит политику, запрещающую имитация аккаунтов, искажение информации о стране происхождения или сокрытие связи с государственным деятелем. Эти политики также запрещают искусственное увеличение показателей вовлеченности с помощью автоматических систем или предоставления видеороликов ничего не подозревающим зрителям.

4. Политика TikTok

В январе 2020 года TikTok предоставил пользователям возможность помечать контент как дезинформацию, выбрав новую категорию «вводящая в заблуждение информация». Принадлежащий китайской компании ByteDance TikTok был замешан в проблемах с конфиденциальностью, поскольку китайское законодательство требует, чтобы компании выполняли правительственные запросы на передачу данных. В апреле 2020 года TikTok опубликовал заявление об обработке личной информации компанией , отмечая «соблюдение всемирно признанных стандартов контроля безопасности, таких как NIST CSF, ISO 27001 и SOC2», в целях большей прозрачности и ограничения на «количество сотрудников, имеющих доступ к пользовательским данным».

Несмотря на то, что подобные опасения по поводу конфиденциальности широко освещались в публичных дебатах, связанных с платформой, дезинформация также является проблемой, которую решает компания. В ответ на эти проблемы TikTok реализовал политику запрета дезинформации которая может причинить вред пользователям, «включая контент, вводящий людей в заблуждение относительно выборов или других гражданских процессов, контент, распространяемый кампаниями в целях дезинформации, а также дезинформацию о здоровье». Эти политики применяются ко всем пользователям TikTok (независимо от того, являются ли они публичными фигурами). Они применяются посредством комбинации удаления контента, блокировки аккаунтов и усложнения поиска вредоносного контента, такого как дезинформация и теории заговора, в рекомендациях платформы или функции поиска. TikTok установил политику модерации, «которая запрещает специально подготовленный или манипулятивный контент, который вводит пользователей в заблуждение, искажая правду событий таким образом, чтобы причинить вред». Это включает в себя запрет на дипфейки с целью предотвращения распространения дезинформации.

5. Политики Snapchat

В январе 2017 года Snapchat впервые разработал политику по борьбе с распространением дезинформации. Snapchat внедрил политику для своих поставщиков новостей на странице Discover на платформе, чтобы бороться с дезинформацией, а также регулировать информацию, которая считается неприемлемой для несовершеннолетних. Эти новые правила требуют, чтобы новостные агентства проверяли свои статьи перед тем, как их можно будет отобразить на странице «Обзоры» платформы в целях предотвращения распространения вводящей в заблуждение информации.

В своей статье генеральный директор Snapchat Эван Шпигель описал платформу как отличающуюся от других типов социальных сетей и многих других платформ, утверждая, что «контент, предназначенный для совместного использования друзьями, не обязательно является контентом, предназначенным для предоставления точной информации». Присущее отличие Snapchat от других платформ позволяет бороться с дезинформацией уникальным способом. В Snapchat нет потока информации от пользователей, как это происходит со многими другими платформами социальных сетей — различие, которое делает Snapchat сопоставимым с приложением для обмена сообщениями. Благодаря обновлениям Snapchat платформу используют редакторы-люди, которые отслеживают и регулируют то, что продвигается на странице Discover, предотвращая распространение ложной информации.

В июне 2020 года Snapchat опубликовал заявление, в котором выражается солидарность с сообществом чернокожих на фоне протестов Black Lives Matter после смерти Джорджа Флойда. Платформа заявляет, что «может и впредь позволять разобщенным людям поддерживать учетную запись в Snapchat, пока контент, публикуемый в Snapchat, соответствует нашим правилам сообщества [Snapchat], но мы [Snapchat] в любом случае не будем продвигать эту учетную запись или контент». Snapchat также объявил, что больше не будет продвигать твиты президента Трампа на домашней странице Discover, ссылаясь на то, что «его публичные комментарии на сайте могут спровоцировать насилие».

6. ВКонтакте

Хотя многие из крупнейших платформ приняли политику, направленную на борьбу с дезинформацией, из этой тенденции есть заметные исключения. Например, ВКонтакте — одна из самых популярных социальных сетей в России, и ее приводят в пример за использование для распространения дезинформации, особенно на выборах в России. Платформа также отмечается за ее использование поддерживаемыми Кремлем группами для распространения дезинформации за пределы России для влияния на выборы в других странах, таких как Украина. Хотя платформа часто используется как средство распространения дезинформации, не похоже, что ВКонтакте применяет какие-либо политики, чтобы остановить распространение фейковых новостей.

7. Parler

Parler была создана в 2018 году, и ее часто называли «альтернативой» Twitter для консервативных пользователей, в основном из-за ориентации на свободу слова лишь с минимальной политикой модерации. Эта неограниченный, немодерируемый дискурс привел к росту антисемитизма, ненависти, дезинформации и пропаганды, а также экстремизма. Сеть Parler была связана со скоординированным планированием атаки 6 января на Капитолий в США. После этого события несколько служб, включая Amazon, Apple и Google, удалили Parler со своих платформ из-за отсутствия модерации контента и серьезного риска для общественной безопасности. Этот шаг демонстрирует способы, с помощью которых более широкий рынок может оказывать давление на определенные платформы для реализации политики по борьбе с дезинформацией и другим вредоносным контентом.

(B). Технические и программные меры по сокращению дезинформации

Платформы частного сектора разработали ряд функций продукта и технических мер, призванных помочь ограничить распространение дезинформации при соблюдении баланса интересов свободы слова. Дизайн и реализация этих механизмов во многом зависят от характера и функциональности конкретных платформ. В данном разделе рассматриваются ответы на этих платформах, включая традиционные социальные сети, платформы для обмена изображениями и видео, а также приложения для обмена сообщениями. Следует отметить, что одна из самых больших проблем, которые эти платформы пытались и продолжают решать повсеместно, — это виральность, то есть скорость, с которой информация распространяется на этих платформах. Когда виральность сочетается с алгоритмической предвзятостью, это может привести к скоординированным кампаниям дезинформации, гражданским беспорядкам и насильственному причинению вреда.

1. Традиционные социальные сети

Две из крупнейших в мире социальных сетей, Facebook и Twitter, внедрили меры и функции, которые работают либо для подавления виральности дезинформации и предупреждения пользователей о ее присутствии, либо для создания преград, которые влияют на поведение пользователей, чтобы замедлить распространение ложной информации внутри сети и по всему миру.

В Twitter программные группы в 2020 году начали развертывать автоматические подсказки, предупреждающие пользователей об обмене ссылками, которые они сами не открывали; эта мера призвана «способствовать информированному обсуждению» и побуждать пользователей оценивать информацию, прежде чем делиться ею. Это следует за введением меток контента и предупреждений, которые платформа прикрепляет к твитам, которые не подлежат удалению в соответствии с политиками платформы (или в соответствии с исключением «общественных интересов» компании, как описано выше), но которые, тем не менее, могут содержать дезинформацию или манипулятивные медиа. Хотя эти метки предоставляют пользователям дополнительный контекст (и более подробно рассматриваются в разделе этой главы, посвященном таким функциям), сами метки представляют собой сигнал и потенциальный барьер, который может повлиять на решение пользователя делиться или распространять дезинформацию.

Технические усилия Facebook по ограничению дезинформации включают использование алгоритмических стратегий для «понижения рейтинга» ложной или спорной информации, уменьшения видимости контента в ленте новостей и уменьшения степени, в которой публикация может быть обнаружена органически. Компания также применяет эти ограничения в распространении в отношении целых страниц и веб-сайтов, которые неоднократно делятся фейковыми новостями. Компания также начала использовать уведомления для пользователей, которые взаимодействовали с определенной дезинформацией и дезинформацией в ограниченном контексте, например, в связи с конкретными выборами или дезинформацией о здоровье, связанной с пандемией COVID-19. Хотя эта мера имеет ограниченное применение, компания заявляет, что эти уведомления являются частью попытки «помочь друзьям и семье избежать ложной информации».

И Twitter, и Facebook используют автоматизацию для обнаружения определенных типов дезинформации и некорректной информации, а также для обеспечения соблюдения политик в отношении контента. Эти системы сыграли более важную роль во время пандемии, поскольку проблемы общественного здравоохранения вынудили модераторов контента покинуть офисы. Компании аналогичным образом используют технические инструменты, чтобы помочь в обнаружении манипулятивной активности на своих платформах. Хотя эти усилия не видны пользователям, компании публично раскрывают результаты этих усилий в периодических отчетах о прозрачности, которые включают данные об удалении учетной записи. Эти функции продукта были развернуты по всему миру, в том числе в Шри-Ланке, Мьянме, Нигерии и других странах.

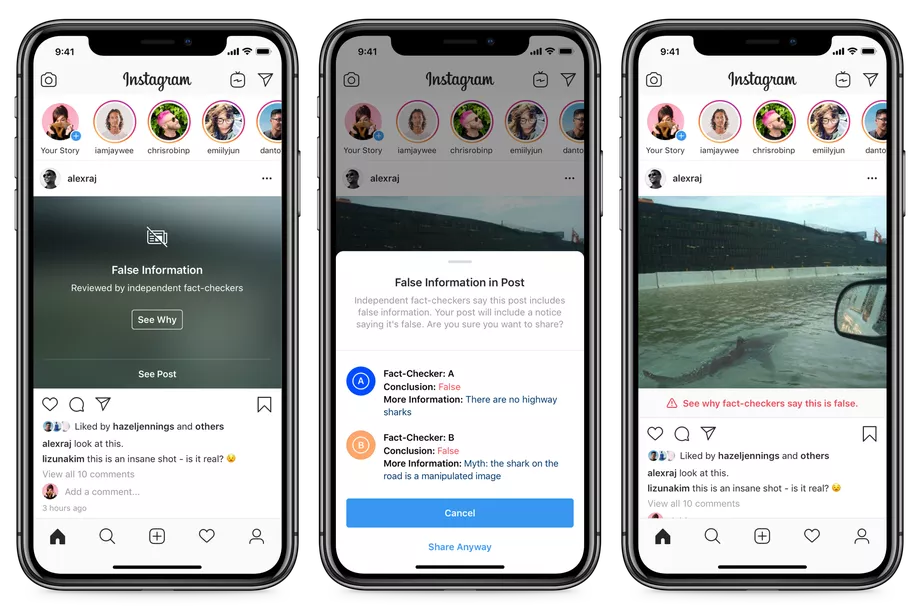

Платформы, которые делятся видео и изображениями, также интегрировали в свои продукты функции, ограничивающие распространение ложной информации. В Instagram, компании в составе Facebook, платформа удаляет контент, идентифицированный как дезинформация, со своей страницы Explore и из хэштегов; платформа также затрудняет поиск аккаунтов, которые постоянно публикуют дезинформацию, путем фильтрации контента из этой учетной записи на доступных для поиска страницах. Примеры того, как Instagram интегрировал борьбу с дезинформацией и некорректной информацией в разработку своих продуктов, показаны ниже:

TikTok использует технологии для улучшения своей практики модерации контента, в частности, для помощи в выявлении недостоверного поведения, шаблонов и учетных записей, предназначенных для распространения вводящего в заблуждение или спам-контента. Компания отмечает, что ее инструменты обеспечивают соблюдение своих правил и затрудняют поиск вредоносного контента, такого как дезинформация и теории заговора, в рекомендациях или функциях поиска платформы.

Чтобы поддержать соблюдение своих правил, YouTube аналогично использует технологии, в частности машинное обучение, для поддержки своих усилий. Как отмечает компания в своей политике, «машинное обучение хорошо подходит для выявления закономерностей, что помогает нам находить контент, похожий на другой контент, который мы уже удалили, даже до его просмотра».

2. Приложения для обмена сообщениями

Платформы обмена сообщениями оказались важным вектором распространения дезинформации. Риски особенно заметны среди закрытых зашифрованных платформ, где компании не могут отслеживать или просматривать контент.

Несмотря на сложность проблемы дезинформации на закрытых платформах, WhatsApp, в частности, разрабатывает технические подходы для снижения рисков. После эпизода насилия в Индии, связанного с вирусными сообщениями на платформе, рассылаемыми большим группам до 256 пользователей одновременно, WhatsApp в 2018 году введены ограничения на пересылку сообщений, которые не позволяют пользователям пересылать сообщение более чем пяти людям, а также визуальные индикаторы, позволяющие пользователям различать перенаправленные сообщения и исходный контент. Совсем недавно, в контексте пандемии COVID-19, WhatsApp еще больше ограничил пересылку, объявив, что сообщения, которые были перенаправлены более пяти раз, впоследствии могут быть переданы только одному пользователю за раз. Хотя зашифрованная природа платформы затрудняет оценку воздействия этих ограничений на дезинформацию, компания сообщает, что ограничения снизили распространение пересылаемых сообщений на 70%.

Помимо ограничения в отношении пересылки на платформе, WhatsApp также разработал системы для идентификации и удаления автоматических учетных записей, которые отправляют большие объемы сообщений. Платформа экспериментирует с методами обнаружения закономерностей в сообщениях с помощью методов оценки гомоморфного шифрования. Эти стратегии могут помочь в информировании анализа и технических вмешательств, связанных с кампаниями дезинформации в будущем.

WhatsApp, принадлежащий Facebook, особенно стремится бороться с дезинформацией о COVID-19, поскольку такой контент продолжает распространяться как вирусный.. Усилия компании помогли остановить распространение дезинформации и некорректной информации, связанной с COVID. WhatsApp создал чат-бота WHO Health Alert, чтобы предоставлять точную информацию о COVID-19. Пользователи могут отправлять текстовые сообщения на номер телефона, чтобы получить доступ к чат-боту. Чат-бот изначально предоставляет основную информацию и позволяет пользователям задавать вопросы по темам, включая последние цифры, защиту, разрушители мифов, советы путешественникам и текущие новости. Это позволяет пользователям получать точные сведения и прямые ответы на свои вопросы. WhatsApp предоставил информацию через этот сервис более чем одному миллиону пользователей.

3. Поисковые системы

Google реализовал технические усилия по обеспечению честности информации при поиске. Google изменил алгоритм поиска, чтобы бороться с распространением фейковых новостей и теориями заговора. В своем сообщении в блоге вице-президент Google по разработке Бен Гомес написал, что компания «поможет отображать больше авторитетных страниц и понизить уровень некачественного контента» в поиске. Стремясь предоставить более совершенные рекомендации по поиску, Google добавляет реальных людей, которые будут выступать в качестве оценщиков, чтобы «оценить качество результатов поиска Google — дать нам отзывы о наших экспериментах». Google также предоставит «инструменты прямой обратной связи», позволяющие пользователям отмечать бесполезный, конфиденциальный или неприемлемый контент, который появляется в их результатах поиска.